ບົນພື້ນຖານເຕັກໂນໂລຊີ, ວິວັດທະນາການຂອງປັນຍາປະດິດ (AI) ສືບຕໍ່ຊຸກຍູ້ການປະດິດສ້າງທີ່ພິເສດ. ຢ່າງໃດກໍຕາມ, ມັນພ້ອມໆກັນໄດ້ເປີດເຜີຍຄໍາບັນຍາຍທີ່ເຕັມໄປດ້ວຍຄວາມເປັນຫ່ວງກ່ຽວກັບການສູນພັນຂອງມະນຸດ. ນັກວິໄສທັດ AI ເຊັ່ນ Sam Altman, ຫົວຫອກຂອງ OpenAI, ແລະ Geoffrey Hinton, ທີ່ໄດ້ຮັບການຍອມຮັບຈາກທົ່ວໂລກວ່າເປັນ "ເຈົ້າພໍ່" ຂອງ AI, ໄດ້ສະແດງຄວາມຢ້ານກົວນີ້ຢ່າງຈະແຈ້ງ.

ການເປີດເຜີຍໄພພິບັດທີ່ອາດຈະເກີດຂື້ນ, ຈົດຫມາຍເປີດຈາກສູນຄວາມປອດໄພ AI, ໄດ້ຮັບການຮັບຮອງໂດຍຜູ້ລົງນາມທີ່ໄດ້ຮັບການນັບຖືຫຼາຍກວ່າ 300 ຄົນ, ໄດ້ນໍາເອົາຄວາມສະຫວ່າງຂອງໄພຂົ່ມຂູ່ທີ່ມີຢູ່ທີ່ AI ນໍາສະເຫນີ. ແນວໃດກໍ່ຕາມ, ການອັດສະຈັນທີ່ມະນຸດສ້າງຂຶ້ນນີ້ອາດຈະກາຍເປັນການຍົກເລີກຂອງມະນຸດໄດ້ແນວໃດ ຍັງຄົງເປັນເລື່ອງທີ່ຫນ້າສົງໄສຢູ່.

AI ມີຄວາມສ່ຽງຕໍ່ການສູນພັນຂອງມະນຸດ

ປັນຍາປະດິດສາມາດຊອກຫາຊ່ອງທາງຫຼາຍຢ່າງຕໍ່ກັບຄວາມສ່ຽງຕໍ່ສັງຄົມ, ອີງຕາມການ Dan Hendrycks, ຜູ້ອໍານວຍການສູນຄວາມປອດໄພ AI. ການໃຊ້ AI ໃນທາງທີ່ຜິດໂດຍໜ່ວຍງານທີ່ຮ້າຍກາດນຳສະເໜີສະຖານະການດັ່ງກ່າວ.

"ມີຄວາມເຂົ້າໃຈຜິດທົ່ວໄປຫຼາຍ, ເຖິງແມ່ນວ່າຢູ່ໃນຊຸມຊົນ AI, ວ່າມີພຽງແຕ່ຈໍານວນຫນ້ອຍຂອງ doomers. ແຕ່, ໃນຄວາມເປັນຈິງ, ປະຊາຊົນຈໍານວນຫຼາຍສ່ວນຕົວຈະສະແດງຄວາມກັງວົນກ່ຽວກັບສິ່ງເຫຼົ່ານີ້,” Hendrycks ເວົ້າ.

ຈິນຕະນາການເອົາກໍາລັງທີ່ໂຫດຮ້າຍທີ່ກໍາລັງໃຊ້ AI ເພື່ອສ້າງອາວຸດຊີວະພາບທີ່ມີຄວາມຕາຍເກີນໂລກລະບາດທໍາມະຊາດ. ຕົວຢ່າງອີກອັນຫນຶ່ງແມ່ນການເປີດຕົວ AI rogue ດ້ວຍຄວາມຕັ້ງໃຈທີ່ຈະເປັນອັນຕະລາຍຢ່າງກວ້າງຂວາງ.

ຖ້າລະບົບ AI ໄດ້ຮັບຄວາມສະຫຼາດ ຫຼືຄວາມສາມາດພຽງພໍ, ມັນອາດຈະສ້າງຄວາມເສຍຫາຍໃນທົ່ວສັງຄົມ.

ທ່ານ Hendrycks ກ່າວຕື່ມວ່າ "ນັກສະແດງທີ່ເປັນອັນຕະລາຍສາມາດປ່ອຍຕົວ AI ທີ່ໂຫດຮ້າຍໂດຍເຈດຕະນາທີ່ພະຍາຍາມເປັນອັນຕະລາຍຕໍ່ມະນຸດ."

ຢ່າງໃດກໍຕາມ, ນີ້ບໍ່ແມ່ນພຽງແຕ່ໄພຂົ່ມຂູ່ໄລຍະສັ້ນທີ່ເປັນຫ່ວງຜູ້ຊ່ຽວຊານ. ຍ້ອນວ່າ AI ເຂົ້າໄປໃນດ້ານຕ່າງໆຂອງເສດຖະກິດ, ການຍົກເລີກການຄວບຄຸມທາງດ້ານເຕັກໂນໂລຢີອາດຈະນໍາໄປສູ່ບັນຫາໃນໄລຍະຍາວ.

ການເພິ່ງພາອາໄສ AI ນີ້ສາມາດ "ປິດພວກມັນ" ລົບກວນແລະບໍ່ສາມາດເຂົ້າໃຈໄດ້. ດັ່ງນັ້ນ, ຄວາມສ່ຽງຕໍ່ການຄອບຄອງຂອງມະນຸດຕໍ່ອະນາຄົດຂອງມັນ.

ການໃຊ້ໃນທາງທີ່ຜິດ ແລະຜົນກະທົບທີ່ໄກເຖິງຂອງມັນ

ດັ່ງທີ່ Sam Altman ໄດ້ເຕືອນ, ຄວາມສາມາດຂອງ AI ໃນການສ້າງຂໍ້ຄວາມ, ຮູບພາບ, ແລະວິດີໂອທີ່ໜ້າເຊື່ອຖືສາມາດນໍາໄປສູ່ບັນຫາທີ່ສໍາຄັນ. ແທ້ຈິງແລ້ວ, ລາວເຊື່ອວ່າ "ຖ້າເຕັກໂນໂລຢີນີ້ຜິດພາດ, ມັນອາດຈະຜິດພາດຫຼາຍ."

ຕົວຢ່າງເຊັ່ນ, ຮູບພາບປອມທີ່ສະແດງເຖິງການລະເບີດໃຫຍ່ຢູ່ໃກ້ກັບ Pentagon ທີ່ຖືກເຜີຍແຜ່ໃນສື່ສັງຄົມ. ມັນເຮັດໃຫ້ຕະຫຼາດຫຼັກຊັບຫຼຸດລົງຊົ່ວຄາວຍ້ອນວ່າບັນຊີສື່ມວນຊົນສັງຄົມຈໍານວນຫຼາຍ, ລວມທັງບັນຊີທີ່ຖືກກວດສອບຫຼາຍ, ໄດ້ເຜີຍແຜ່ຮູບພາບທີ່ຫຼອກລວງໃນເວລາພຽງແຕ່ນາທີ, ເຮັດໃຫ້ຄວາມວຸ່ນວາຍເພີ່ມຂຶ້ນ.

ການໃຊ້ AI ທີ່ບໍ່ຖືກຕ້ອງດັ່ງກ່າວຊີ້ໃຫ້ເຫັນເຖິງທ່າແຮງຂອງເຕັກໂນໂລຢີໃນການເຜີຍແຜ່ຂໍ້ມູນຂ່າວສານທີ່ບໍ່ຖືກຕ້ອງແລະຂັດຂວາງຄວາມສາມັກຄີຂອງສັງຄົມ. ສະຖາບັນຈັນຍາບັນຂອງ Oxford ໃນ AI ຜູ້ຮ່ວມຄົ້ນຄ້ວາອາວຸໂສ Elizabeth Renieris ຢືນຢັນວ່າ AI ສາມາດ "ຊຸກຍູ້ການເພີ່ມຂື້ນຂອງປະລິມານແລະການແຜ່ກະຈາຍຂອງຂໍ້ມູນທີ່ບໍ່ຖືກຕ້ອງ, ດັ່ງນັ້ນການທໍາລາຍຄວາມເປັນຈິງແລະທໍາລາຍຄວາມໄວ້ວາງໃຈຂອງປະຊາຊົນ."

ທ່າອ່ຽງທີ່ໜ້າເປັນຫ່ວງອີກອັນໜຶ່ງແມ່ນການປະກົດຕົວຂອງ AI ທີ່ເປັນຕາຢ້ານ. ນີ້ແມ່ນປະກົດການທີ່ບໍ່ພໍໃຈທີ່ AI spews ຂໍ້ມູນທີ່ຜິດພາດແຕ່ເບິ່ງຄືວ່າເປັນທີ່ເຊື່ອຖືໄດ້.

ຂໍ້ບົກພ່ອງນີ້, ສະແດງໃຫ້ເຫັນໃນເຫດການທີ່ຜ່ານມາທີ່ກ່ຽວຂ້ອງກັບ ChatGPT, ສາມາດທ້າທາຍຄວາມຫນ້າເຊື່ອຖືຂອງບໍລິສັດທີ່ນໍາໃຊ້ AI ແລະສືບຕໍ່ການແຜ່ກະຈາຍຂອງຂໍ້ມູນທີ່ບໍ່ຖືກຕ້ອງ.

ການເຊາະເຈື່ອນຂອງວຽກແລະການລະເບີດຂອງຄວາມບໍ່ສະເຫມີພາບ

ການຮັບຮອງເອົາ AI ຢ່າງໄວວາໃນທົ່ວອຸດສາຫະກໍາຕ່າງໆເຮັດໃຫ້ເງົາທີ່ຫນ້າເປັນຫ່ວງທີ່ຍາວນານຕໍ່ຕະຫຼາດວຽກ. ໃນຂະນະທີ່ເຕັກໂນໂລຢີພັດທະນາ, ການລົບລ້າງວຽກທີ່ມີທ່າແຮງຫຼາຍລ້ານຄົນໄດ້ກາຍເປັນຄວາມກັງວົນອັນຮີບດ່ວນ.

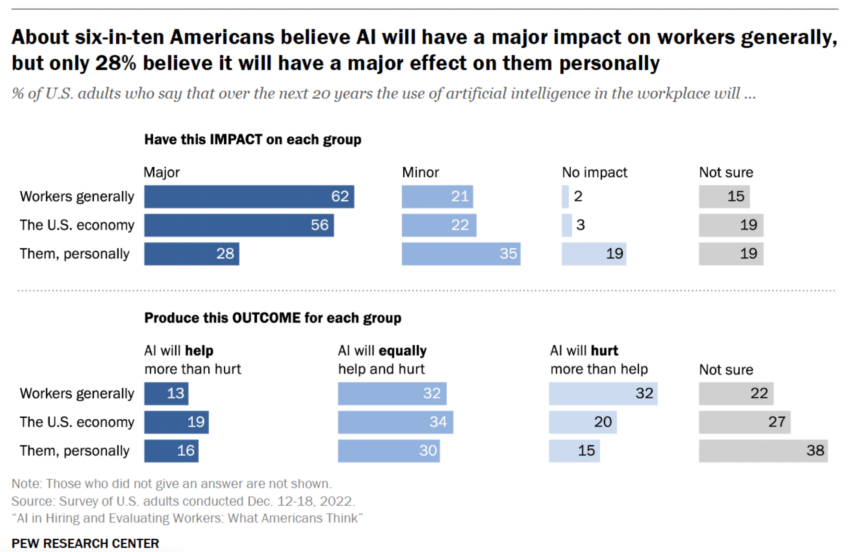

ບໍ່ດົນມານີ້ ການສໍາຫຼວດ ເປີດເຜີຍວ່າຊາວອາເມຣິກັນ 20 ໃນ 28 ຄົນເຊື່ອວ່າການໃຊ້ AI ຢູ່ໃນບ່ອນເຮັດວຽກຈະສົ່ງຜົນກະທົບຢ່າງຫຼວງຫຼາຍຕໍ່ຄົນງານໃນ 15 ປີຂ້າງໜ້າ. ປະມານ XNUMX% ຂອງຜູ້ຕອບຄິດວ່າການນໍາໃຊ້ເຕັກໂນໂລຢີຈະສົ່ງຜົນກະທົບຕໍ່ພວກເຂົາສ່ວນບຸກຄົນ, ແລະອີກ XNUMX% ເຊື່ອວ່າ "AI ຈະເຈັບປວດຫຼາຍກວ່າການຊ່ວຍເຫຼືອ."

ການເພີ່ມຂຶ້ນຂອງການຕັດສິນໃຈແບບອັດຕະໂນມັດອາດຈະປະກອບສ່ວນເພີ່ມຄວາມລໍາອຽງ, ການຈໍາແນກແລະການຍົກເວັ້ນ. ມັນຍັງອາດຈະຊຸກຍູ້ສະພາບແວດລ້ອມຂອງຄວາມບໍ່ສະເຫມີພາບ, ໂດຍສະເພາະຜົນກະທົບຕໍ່ຜູ້ທີ່ຢູ່ໃນດ້ານທີ່ບໍ່ຖືກຕ້ອງຂອງການແບ່ງປັນດິຈິຕອນ.

ຍິ່ງໄປກວ່ານັ້ນ, ການປ່ຽນແປງໄປສູ່ການເພິ່ງພາອາໄສ AI ສາມາດສົ່ງຜົນໃຫ້ "ຄວາມອິດເມື່ອຍ" ຂອງມະນຸດ. ນີ້ອາດຈະຄ້າຍຄືກັນກັບສະຖານະການ dystopian ໃນຮູບເງົາເຊັ່ນ: Wall-E.

ສູນຄວາມປອດໄພ AI ສັງເກດເຫັນວ່າຄວາມເດັ່ນຂອງ AI ອາດຈະຕົກຢູ່ພາຍໃຕ້ການຄວບຄຸມຂອງຫນ່ວຍງານຈໍານວນຈໍາກັດ. ມັນອາດຈະເຮັດໃຫ້ "ລະບອບບັງຄັບໃຊ້ຄ່າແຄບໂດຍຜ່ານການເຝົ້າລະວັງແລະການກົດຂີ່ຂົ່ມເຫັງ."

ວິໄສທັດໃນອະນາຄົດອັນມືດມົນນີ້ຊີ້ໃຫ້ເຫັນຄວາມສ່ຽງທີ່ອາດຈະກ່ຽວຂ້ອງກັບ AI ແລະຊີ້ໃຫ້ເຫັນເຖິງຄວາມຈໍາເປັນຂອງກົດລະບຽບແລະການຄວບຄຸມທີ່ເຂັ້ມງວດ.

ການຮຽກຮ້ອງກົດລະບຽບ AI

ແຮງໂນ້ມຖ່ວງຂອງຄວາມກັງວົນເຫຼົ່ານີ້ໄດ້ເຮັດໃຫ້ຜູ້ນໍາອຸດສາຫະກໍາສະຫນັບສະຫນູນກົດລະບຽບ AI ທີ່ເຄັ່ງຄັດ. ການຮຽກຮ້ອງການແຊກແຊງຂອງລັດຖະບານນີ້ສະແດງໃຫ້ເຫັນຄວາມເຫັນດີທີ່ເພີ່ມຂຶ້ນວ່າການພັດທະນາແລະການນໍາໃຊ້ AI ຄວນໄດ້ຮັບການຄຸ້ມຄອງຢ່າງລະມັດລະວັງເພື່ອປ້ອງກັນການນໍາໃຊ້ທີ່ບໍ່ຖືກຕ້ອງແລະການລົບກວນທາງສັງຄົມໂດຍບໍ່ໄດ້ຕັ້ງໃຈ.

AI ມີທ່າແຮງທີ່ຈະເປັນຜົນປະໂຫຍດຫຼືການຫ້າມ, ຂຶ້ນກັບວິທີການຈັດການກັບມັນ. ມັນເປັນສິ່ງ ສຳ ຄັນທີ່ຈະຊຸກຍູ້ການສົນທະນາທົ່ວໂລກກ່ຽວກັບການຫຼຸດຜ່ອນຄວາມສ່ຽງໃນຂະນະທີ່ເກັບກ່ຽວຜົນປະໂຫຍດຂອງເຕັກໂນໂລຢີທີ່ມີປະສິດທິພາບນີ້.

ນາຍົກລັດຖະມົນຕີອັງກິດ Rishi Sunak ຮັກສາວ່າ AI ໄດ້ເປັນເຄື່ອງມືໃນການຊ່ວຍເຫຼືອບຸກຄົນທີ່ເປັນອໍາມະພາດໃຫ້ຍ່າງແລະຄົ້ນພົບຢາຕ້ານເຊື້ອໃຫມ່. ຢ່າງໃດກໍຕາມ, ມັນເປັນສິ່ງຈໍາເປັນທີ່ພວກເຮົາໃຫ້ແນ່ໃຈວ່າຂະບວນການເຫຼົ່ານີ້ຖືກດໍາເນີນຢ່າງປອດໄພແລະປອດໄພ.

"ປະຊາຊົນຈະມີຄວາມກັງວົນຕໍ່ບົດລາຍງານວ່າ AI ມີຄວາມສ່ຽງທີ່ມີຢູ່, ເຊັ່ນ: ໂລກລະບາດຫຼືສົງຄາມນິວເຄຼຍ. ຂ້າພະເຈົ້າຢາກໃຫ້ພວກເຂົາມີຄວາມໝັ້ນໃຈວ່າ ລັດຖະບານກຳລັງເບິ່ງຢ່າງລະມັດລະວັງໃນເລື່ອງນີ້,” ທ່ານ Sunak ກ່າວ.

ການຄຸ້ມຄອງ AI ຕ້ອງກາຍເປັນບູລິມະສິດທົ່ວໂລກເພື່ອປ້ອງກັນບໍ່ໃຫ້ມັນກາຍເປັນໄພຂົ່ມຂູ່ຕໍ່ການມີຢູ່ຂອງມະນຸດ. ເພື່ອນຳໃຊ້ຜົນປະໂຫຍດຂອງ AI ໃນຂະນະທີ່ຫຼຸດຜ່ອນຄວາມສ່ຽງຕໍ່ການສູນພັນຂອງມະນຸດ, ມັນເປັນສິ່ງ ສຳ ຄັນທີ່ຈະຕ້ອງແລ່ນຢ່າງລະມັດລະວັງແລະລະມັດລະວັງ. ລັດຖະບານຍັງຕ້ອງປະຕິບັດບັນດາລະບຽບການ, ຊຸກຍູ້ການຮ່ວມມືທົ່ວໂລກ, ແລະລົງທຶນໃນການຄົ້ນຄ້ວາຢ່າງເຄັ່ງຄັດ.

ຂໍ້ສັງເກດ

ປະຕິບັດຕາມຄໍາແນະນໍາໂຄງການຄວາມໄວ້ວາງໃຈ, ບົດຄວາມຄຸນນະສົມບັດນີ້ສະເຫນີຄວາມຄິດເຫັນແລະທັດສະນະຈາກຜູ້ຊ່ຽວຊານດ້ານອຸດສາຫະກໍາຫຼືບຸກຄົນ. BeInCrypto ແມ່ນອຸທິດຕົນເພື່ອການລາຍງານທີ່ໂປ່ງໃສ, ແຕ່ທັດສະນະທີ່ສະແດງອອກໃນບົດຄວາມນີ້ບໍ່ຈໍາເປັນຕ້ອງສະທ້ອນເຖິງ BeInCrypto ຫຼືພະນັກງານຂອງມັນ. ຜູ້ອ່ານຄວນກວດສອບຂໍ້ມູນຢ່າງເປັນອິດສະຫຼະແລະປຶກສາກັບຜູ້ຊ່ຽວຊານກ່ອນທີ່ຈະຕັດສິນໃຈໂດຍອີງໃສ່ເນື້ອຫານີ້.

ທີ່ມາ: https://beincrypto.com/artificial-intelligence-ai-risk-of-human-extinction/